ChatGPTを日々の業務で活用していると、やはり気になるのがChatGPT 情報漏洩のリスクですよね。私が周りの方と話していても、どのような事例が過去にあったのか、あるいは個人情報の取り扱いで注意すべき点はどこかといった不安の声をよく耳にします。企業の導入が進む中で、万が一のトラブルを避けるための対策や、情報の消し方を知っておくことは非常に重要です。原因を正しく理解し、適切な設定を行うことで、AIの利便性を損なうことなく安全に使いこなすことができます。この記事を読めば、漠然とした不安を解消し、自信を持って実務に役立てるヒントが見つかるはずです。

- OpenAIが公式に認めた過去のシステム障害と流出の原因

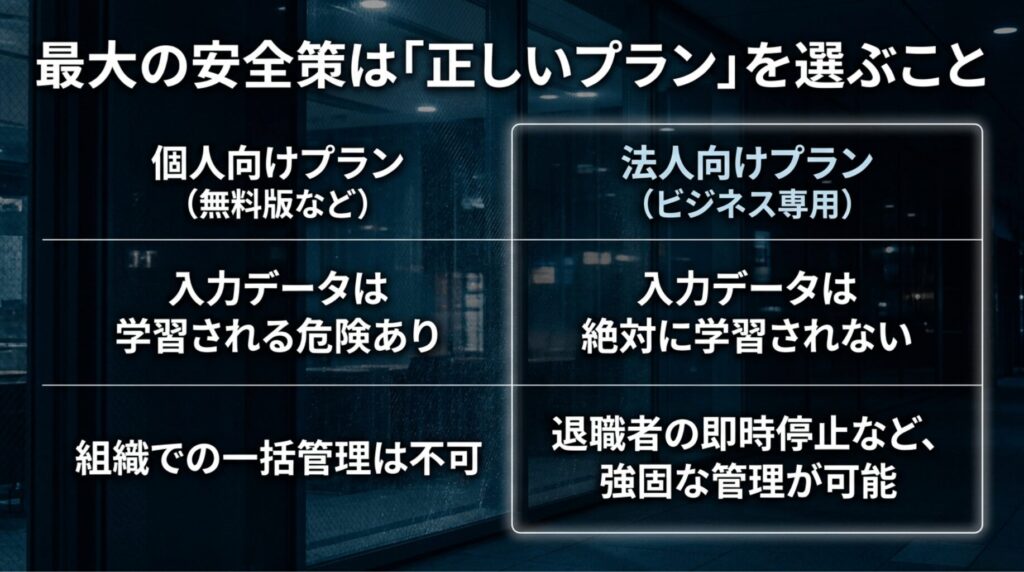

- 個人版と法人プラン(Enterpriseなど)における学習設定の決定的な違い

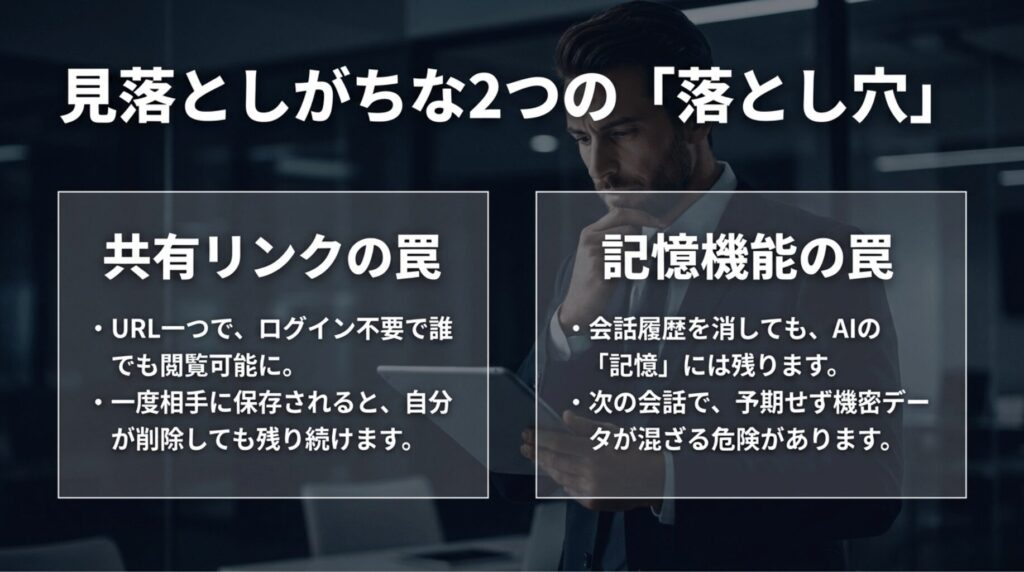

- 共有リンクやメモリ機能など、意外と見落としがちな露出ポイント

- 実務者が今日から実践できる、安全な運用のためのチェックリスト

ChatGPTの情報漏洩の公式事例と主な原因

まずは、ChatGPTに関連して過去にどのようなトラブルが報じられ、どのような仕組みでリスクが生じるのか、事実関係を整理してみたいと思います。正しく恐れるためには、まず現状を知ることが第一歩です。

2023年に発生した公式の事例と技術的背景

OpenAIが公式に認めた、サービス側の不具合による大きな事案は2023年3月20日に発生しました。この障害では、一部のユーザー(当時のPlus加入者の約1.2%)のチャット履歴のタイトルや、最悪の場合は支払い関連の情報(氏名、メールアドレス、カード番号の下4桁など)が別の人に見えてしまう可能性があったというものです。これはユーザーの誤操作ではなく、完全にシステム側の脆弱性が原因でした。

技術的な要因:Redisのバグとキャッシュの混線

このトラブルの背後には、オープンソースのインメモリデータベース「Redis」のクライアントライブラリにおける不具合がありました。非同期処理(Asyncio)の環境下で、リクエストがキャンセルされた際に接続が適切に処理されず、別のユーザーのデータが誤ってキャッシュから引き出されてしまったのです。私たちが普段何気なく使っているブラウザの挙動の裏側で、このような複雑なデータの取り違えが起きていた事実は驚きですよね。

OpenAIはこの件について詳細な調査報告を公開しており、現在は修正と再発防止策が完了したと説明しています。しかし、「サービス障害によって意図せずデータが露出するリスクは物理的にゼロではない」という点は、クラウドツールを使う上で常に頭の片隅に置いておくべき教訓といえます。

(参照元:OpenAI『March 20 ChatGPT outage report』)

この一件以来、OpenAIはバグバウンティプログラム(脆弱性報奨金制度)の導入や、セキュリティ監視体制の強化を急ピッチで進めています。システムである以上、開発者がどれほど注意を払っても「絶対」を保証することは難しいですが、運営側が透明性を持って情報を公開している姿勢には、一定の信頼を置けるかなと私は感じています。

ChatGPTへの個人情報入力に関する法的注意点

日本国内では、2023年6月に個人情報保護委員会がOpenAIに対して行政上の注意喚起を行いました。これは、ChatGPTが学習データを収集する過程で、本人の同意を得ずに「要配慮個人情報(病歴や信条など)」を取得しないよう求めたものです。また、日本語での利用目的の公表や通知も求められました。私たち利用者が「便利だから」という理由だけで何でも入力してしまうと、知らぬ間に法律上のリスクを背負い込むことになりかねません。

実務で意識すべき3つのポイント

私たちが実務で使う際、特に注意したいのは以下の点です。

- 顧客の氏名、住所、電話番号、メールアドレスなどは原則として入力しない。

- 特に「病歴、犯罪歴、人種、信条」などの要配慮個人情報は、絶対に入力しない。

- 社内でAIを利用する際は、個人情報保護法に則った利用規約やガイドラインを作成・周知する。

個人情報保護法は2022年の改正により、個人データの漏洩が発生した際の報告義務が強化されています。もしChatGPT経由で顧客データが流出したと判断された場合、企業として重い社会的責任を問われる可能性があります。入力前に「この情報は公開されても大丈夫か?」と自問自答する癖をつけたいですね。

正確な法律の適用範囲や最新の規制状況については、必ず個人情報保護委員会の公式サイトを確認するか、弁護士などの法務の専門家にご相談ください。AIの進化は非常に速いため、昨日までの常識が今日通用しなくなることもあります。

企業の機密情報入力による流出リスクと防止策

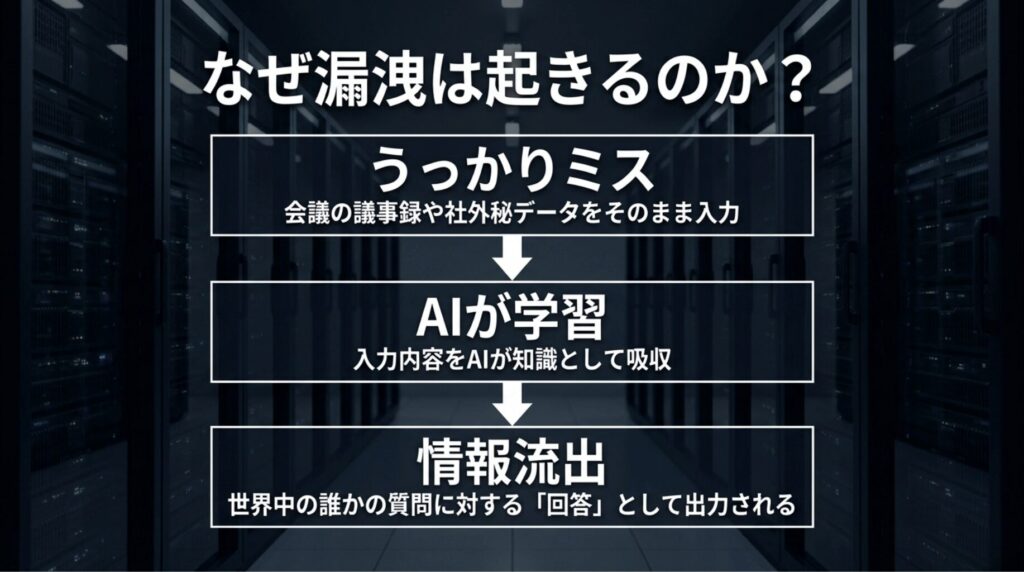

ニュースで話題になった有名な事例として、韓国Samsung Electronicsのケースがあります。複数の従業員が、半導体設備の計測プログラムのソースコードをバグ修正のために貼り付けたり、機密性の高い会議の内容を要約するために議事録をそのままChatGPTへ投入したりしてしまったというものです。これはシステムの不具合ではなく、「利用者のセキュリティ意識の欠如」が原因で起きた、典型的な誤入力型漏えいです。

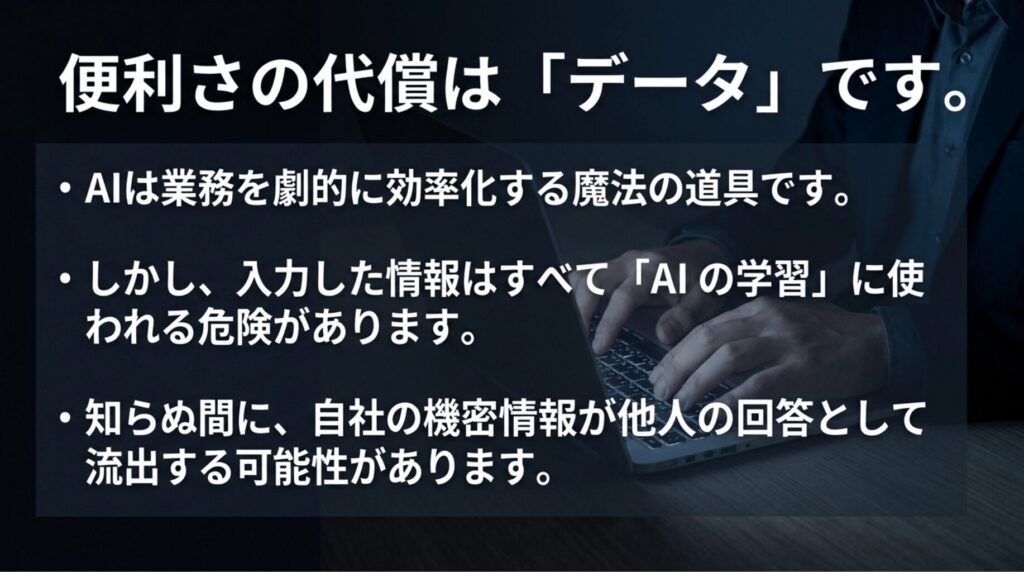

なぜ入力しただけで「漏洩」になるのか?

個人版の既定設定では、ユーザーが入力したプロンプト(指示文)は、AIの性能向上のための「学習」に利用される可能性があります。つまり、あなたが入力した秘伝のソースコードや経営戦略が、将来的に世界中の誰かが出した質問に対する「回答」の一部として生成されるリスクが否定できないのです。これが企業にとって最も恐ろしい情報流出のシナリオです。

対策:シャドーAIの撲滅と公式ツールの提供

「AIを禁止する」だけでは、利便性を求める従業員が隠れて個人アカウントを使ってしまう「シャドーAI」を招きます。会社側が安全な法人向けプラン(EnterpriseやTeamなど)を正式に契約し、適切なツールを提供することが、結果として最大の安全策になります。

また、一度入力してしまった情報をOpenAI側のサーバーから完全に抹消するのは容易ではありません。そのため、「事後の削除」よりも「事前の教育」と「環境整備」に注力することが、実務者としての賢い立ち回りと言えるでしょう。

共有リンクの危険性と公開後のデータ削除の限界

ChatGPTには特定の会話をURLで第三者に共有できる便利な機能がありますが、この運用には細心の注意が必要です。共有リンクは「リンクを知っている人なら誰でも、ログインなしでその会話を閲覧できる」という仕様です。もし誤って機密情報を含む会話のリンクをSNSや掲示板に投稿してしまったら、その瞬間に情報は全世界へ公開されたも同然です。

削除しても残る?「スナップショット」の落とし穴

さらに深刻なのが、共有後のデータ削除の仕様です。あなたが共有リンクを作成した際、その時点での会話内容が「スナップショット(静的なコピー)」として保存されます。たとえ後から元々のチャット履歴を削除したり、共有リンク自体を管理画面から「削除」したとしても、リンクを共有された相手がすでにその会話を自分のアカウントに「インポート(自分の履歴へコピー)」していた場合、相手側の履歴には内容が残り続けます。

つまり、共有リンクを作った時点で、その情報のコントロール権はあなたの手を離れてしまう可能性があるのです。社内のプロジェクト進捗を共有するなどの用途でも、機密情報が含まれる場合は安易なURL共有は厳禁。どうしても共有が必要な場合は、チャット内容をコピーして、自社の暗号化されたチャットツール等で共有する方が安全です。

この「インポート機能」の存在を意外と知らない方が多いので、バックオフィスや企画担当の方はぜひ周囲にも注意喚起してあげてくださいね。

履歴とは別に残るメモリの消し方と管理のコツ

最近のChatGPT(特にGPT-4以降)には、ユーザーの好みや過去に話した情報を覚える「メモリ機能」が搭載されています。「私はJavaScriptが得意です」とか「会議の議事録は箇条書きにして」といった好みを勝手に学習してくれるので非常に便利ですが、これが情報漏洩の新たな火種になることもあります。

メモリとチャット履歴の「削除」の違い

多くの方が誤解しているのですが、特定のチャット履歴をゴミ箱アイコンで消去しても、その会話から学習された「メモリ」は自動的には消えません。次に全く別の新しいチャットを始めたとき、消したはずの機密情報がメモリから引き出されて回答に混じってしまう、ということが起こり得ます。

| 機能の種類 | 保存・学習の仕組み | 削除の方法 |

|---|---|---|

| チャット履歴 | 会話のログとして保存される。デフォルトでは学習に使われる。 | ゴミ箱ボタンで削除。ただしOpenAI側に30日間バックアップが残る場合あり。 |

| メモリ機能 | 会話のエッセンスを長期記憶として保存。次回以降の会話に反映。 | 設定 > パーソナライズ > メモリ > メモリの管理 から個別に削除。 |

| 一時チャット | 履歴に残らず、学習もされない。 | ウィンドウを閉じれば消えるが、安全監視目的でサーバーには最大30日残る。 |

「履歴を消したから大丈夫!」と過信せず、設定画面からメモリの内容を定期的にチェックするのが、情報の扱いが得意な実務者の新習慣かなと思います。特にプロジェクトの担当を外れるときや、PCを共有する可能性がある場合は、メモリの全消去を行っておくと安心ですね。

ChatGPTで情報漏洩を未然に防ぐための実務的対策

リスクを正しく理解した次は、いよいよ「どうすれば安全に、かつ便利に使い続けられるか」という具体的な対策を深掘りしていきましょう。ちょっとした設定やプランの見直しで、安全性は驚くほど高まります。

企業導入でEnterpriseが安全とされる理由

企業が本格的にChatGPTを導入する際、EnterpriseやTeam、Eduといった法人向けプランが強く推奨されるのには明確な理由があります。それは、「入力したデータがOpenAI側のモデル改善(学習)に一切利用されない」ことが、契約レベルで保証されているからです。

法人プランならではの強力な管理機能

法人プラン(特にEnterprise)には、個人版にはない高度なセキュリティ機能が備わっています。

- SSO(シングルサインオン)連携: 会社のID/パスワードでログインでき、退職者のアカウント即時停止が可能。

- 管理パネル: 誰が、いつ、どの程度AIを利用しているかを可視化できる。

- Compliance API: 会話内容を外部のセキュリティツール(DLPなど)と連携させ、不正な入力を検知・ログ保存できる。

- データ residency(データ所在地): 必要に応じてデータの保存地域(米国以外など)の相談ができる場合がある。

個人版のPlusプラン(月額20ドル)を使っている方も多いですが、ビジネスで顧客データを扱うなら、多少コストはかかってもTeamプランやEnterpriseプランへ移行することを強くお勧めします。これは「安心を月額料金で買う」という、最も確実な投資と言えるかもしれません。

法人契約をすることで、OpenAIとの間でデータ処理に関する合意書(DPA)を締結した状態になるため、法務部門や情シス部門としても導入のハードルがぐっと下がるはずですよ。

APIセキュリティの設計とデータ保持期間の仕様

自社のWebサイトにチャットボットを組み込んだり、独自のツールを作ったりする場合に使用する「API」も、デフォルトでは学習には使われません。しかし、APIならデータが一切残らないと考えるのは早計です。OpenAIは不正利用の監視を目的に、「abuse monitoring logs」として送信データを最大30日間、サーバーに保持しています。

ステートフルなAPIとステートレスなAPIの違い

さらに、APIのエンドポイント(接続先)によっては挙動が異なります。例えば、会話の「状態」を維持してくれる`/v1/conversations`のような新しい仕組みでは、削除リクエストを送るまでデータが保持され続けることもあります。一方で、1回限りのやり取りを行う`/v1/chat/completions`は、レスポンスを返した後は監視ログ以外のデータは保持しません。

ZDR(Zero Data Retention)の活用

銀行や医療機関など、極めて高い機密性が求められる環境では、この「30日間の監視ログ」すら残さないように申請することができます。ただし、OpenAI側の審査を通る必要があり、特定の規約に合意しなければなりません。開発者の方は、設計段階で「どのデータがどこに、いつまで残るか」を明確に定義しておくことが重要です。

「APIだから自動的に安全だ」と思い込まず、最新のAPIドキュメントとプライバシーポリシーを定期的に読み合わせることが、開発・運用チームの信頼性を支える鍵になります。

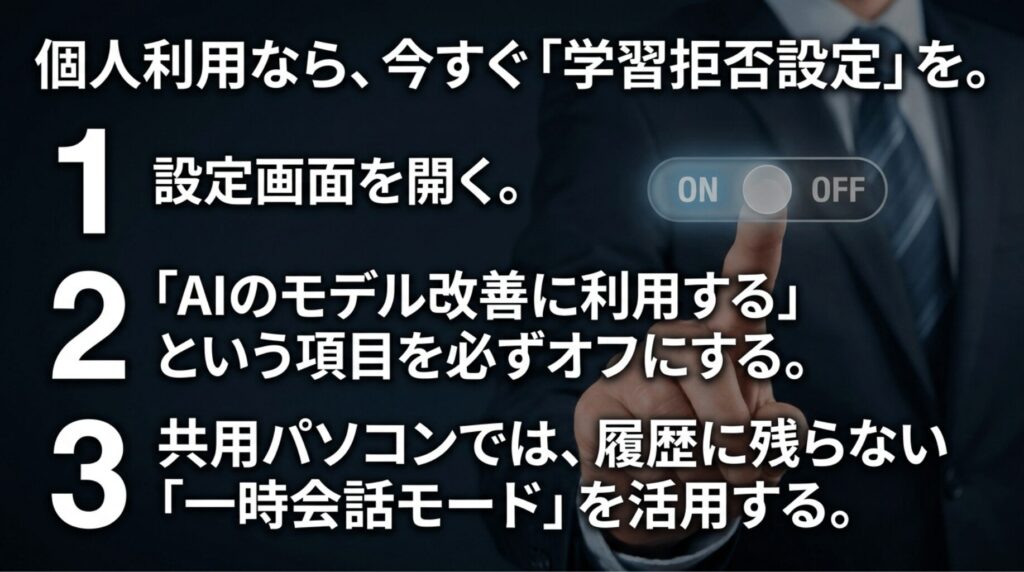

一時チャット設定の活用とモデル学習を拒否する方法

もしあなたが個人向けの無料版やPlusプランを使い続ける必要がある場合、まず最初に行うべきは「学習のオプトアウト(拒否)」設定です。設定画面の「Data Controls」にある「すべての人にモデルを改善する」というスイッチをオフにしてください。これをオフにしている間は、あなたの入力がAIの糧になることはありません。

一時チャット(Temporary Chat)のメリットと限界

さらに、特定のデリケートな会話をしたいときには「一時チャット」モードへの切り替えが非常に有効です。

- 履歴に残らない: 左側のサイドバーに会話が記録されません。

- メモリを使わない: その会話の中で話した内容は、長期記憶として保存されません。

- 学習に使われない: 最初から学習対象外として処理されます。

ただし、注意点があります。一時チャットであっても、OpenAI側のサーバーには安全確認(ヘイトスピーチや犯罪利用のチェック)のために最大30日間、データが保持される可能性があります。「自分の画面から消えた=ネット上からも完全に消滅した」というわけではないことを理解しておきましょう。

ブラウザを閉じれば履歴から消えるので、共用PCでChatGPTを使わざるを得ない場面などでは、この一時チャットモードは必須のテクニックと言えますね。

外部連携アプリやGPTs利用時の権限管理

最近のChatGPTの大きな魅力は、SlackやGitHub、Googleドライブなどの外部ツールと連携できる点です。また、特定の業務に特化した「GPTs(カスタムGPT)」を自作・利用している方も多いでしょう。しかし、ここで最も注意すべきなのは、「GPTアクション」経由で第三者のサーバーへデータが飛んでいくリスクです。

サードパーティへのデータ送信プロセス

あなたがGPTsを使い、外部アプリと連携するボタンを押したとき、ChatGPTはあなたのプロンプトの一部やファイルを、そのアプリの提供元のサーバーへ送信します。このとき、データが安全に扱われるかどうかは、OpenAIではなく「そのアプリの提供元」のプライバシーポリシーに依存します。例えば、見知らぬ個人が作ったGPTsに社内のファイルを読み込ませるのは、非常にリスクが高い行為と言わざるを得ません。

・業務で外部連携を行う際は、会社が認めた信頼できるサービスのみを許可する。

・書き込み権限(ファイルを削除する、メールを送る等)を与える際は、必ず毎回確認(Always allowを避ける)を挟む設定にする。

・Slack等との連携では、Slack側の管理画面でもAI連携の許可範囲を厳しく制限しておく。

便利なツールだからこそ、「データの出口」がどこにあるのかを常に監視する。これが、情報のプロとしての心構えかなと思います。

日本と欧州の規制動向から学ぶ運用のポイント

世界的に見ると、AIと情報の取り扱いに関する法規制は今まさに作られている最中です。特に欧州連合(EU)の動きは速く、2023年にはイタリアのデータ保護当局が、個人情報保護の不備を理由にChatGPTを一時的に利用停止にするという強硬な手段に出ました。その後、OpenAI側が年齢確認や学習拒否権の明確化などの改善を行ったことで解除されましたが、規制当局の目は非常に厳しいままです。

EDPBレポートとローマ裁判所の判決

2024年5月には欧州データ保護会議(EDPB)がタスクフォースの報告書を公表し、透明性の確保やデータの正確性について厳しい基準を示しました。一方で、2026年3月にはローマの裁判所が、イタリア当局がOpenAIに課した制裁金を取り消すという驚きの判決を出しました。これは、法規制の解釈が司法の場でも揺れ動いていることを示しています。

日本国内でも、内閣府の「AI戦略会議」などが継続的にガイドラインを更新しています。私たちが学ぶべきポイントは、「法的にグレーだから何をやっても良い」ではなく、「将来的な規制強化を見越して、今のうちから透明性の高い運用を心がける」ことです。

各国の最新動向を常にチェックするのは大変ですが、基本は「誠実なデータの扱い」に尽きます。利用目的を隠さないこと、ユーザーに選択肢を与えること。この2点を守るだけで、多くの法規制上のリスクは軽減できるはずです。

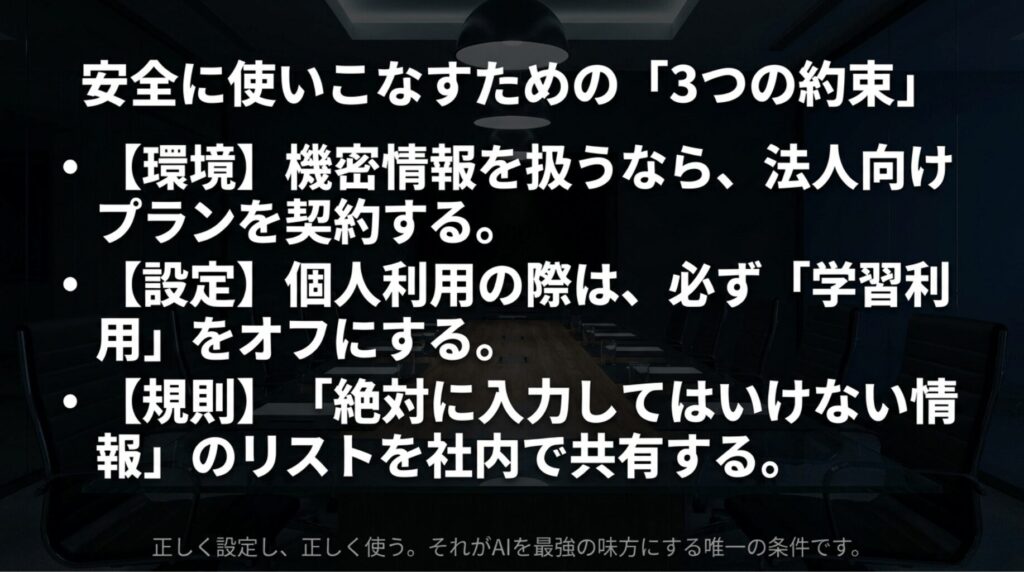

適切な管理と設定でChatGPT情報漏洩を防止する

ここまで長い道のりでしたが、ChatGPT 情報漏洩を防ぐための知識は一通り網羅できたのではないでしょうか。最後に、これまでの内容を整理して、私たちが明日から取るべき行動をまとめたいと思います。

AIは私たちの業務効率を劇的に高めてくれる、魔法のようなツールです。しかし、その裏側には「データ」という対価が存在します。その対価を、いかに安全に、コントロールされた範囲で支払うか。それが私たちユーザーに課せられた知恵の使いどころです。

今日から実践する3つの重要アクション

- プランの最適化: 機密情報を扱うなら、法人プラン(Team / Enterprise)への移行を検討する。

- 設定の徹底: 個人版なら「学習利用」をオフにし、共有リンクの作成は原則として禁止する。

- ルールの明文化: 「これだけは入力してはいけない」というNGリストをチームで共有し、定期的に見直す。

「自分だけは大丈夫」という油断が、最大の脆弱性になります。まずは設定画面を開くことから始めてみませんか?最新の機能アップデートや規約変更については、必ずOpenAIの公式サイトや、日本の公的機関の発表をこまめにチェックするようにしてください。もし不安が残る場合は、ITセキュリティの専門家や法務の専門家を頼るのも、立派なリスク管理のひとつです。

正しく設定し、正しく使う。そうすれば、ChatGPTはあなたのビジネスを加速させる最強のパートナーであり続けてくれるはずですよ!