毎日当たり前のようにChatGPTを使って業務を効率化している私ですが、ふとした瞬間に「これって本当に安全なのかな?」と不安になることがあります。特に、お客様の情報や社外秘のプロジェクトについて相談したいとき、ふと手が止まってしまうんですよね。ChatGPTのセキュリティという言葉で検索してみると、単に危ないかどうかだけでなく、具体的な漏洩対策や学習をさせないための設定、さらには企業での運用ルールなど、知りたいことは山ほど出てきます。近年のChatGPTの進化は凄まじいですが、それに伴って情報の取り扱い方もどんどんアップデートされています。私たちが安心してAIを使い続けるためには、最新の安全性について正しく理解し、自分でできる対策をしっかり行っておくことが大切かなと思っています。以前にChatGPTの情報漏洩を防ぐ具体的な方法を調べた際も、単なる設定変更だけでは不十分だと感じた記憶があります。ChatGPTの安全性を確保するには、個人情報の取り扱いはもちろん、ChatGPT prompt injectionのような技術的な脅威や、ChatGPTのapiセキュリティの仕組みについても、ある程度知っておく必要があります。また、ChatGPTの企業利用におけるセキュリティの観点では、組織全体の統制も欠かせません。この記事では、実務者の視点からこれらのポイントを網羅的に解説していきます。

- ChatGPTでの情報漏洩を防ぐための具体的な入力ルール

- 学習にデータを使わせないための正しい設定手順

- プロンプトインジェクションなどの最新の脅威と対策

- 企業利用や法律に関わるコンプライアンスの基礎知識

ChatGPTのセキュリティと安全性の真実

「AIは魔法のツール」と思われがちですが、その裏側にあるデータ処理の仕組みを理解することが、安全な利用への第一歩です。ここでは、日々の業務でAIを相棒にしている私が、実務を通じて感じたセキュリティの「本質」について掘り下げていきます。特に2026年現在は、単なる設定の有無だけでなく、AIが「外部とどう繋がっているか」が安全性を左右する大きなポイントになっています。

ChatGPTの情報漏洩を防ぐ入力時の注意点

一番身近で、かつ最も怖いのが「うっかりミスによる情報の流出」ですよね。バックオフィスの業務をしていると、大量のデータを処理する機会が多いですが、ChatGPTに投げた質問は基本的にはクラウド上で処理されるため、そこに機密情報を載せることは大きなリスクを伴います。私が徹底しているのは、「名前や住所などの個人を特定できる情報」や「社外秘の数値」をそのまま入れないことです。特に2026年に入り、AIの分析能力が向上したことで、断片的な情報からでも機密が推測されるリスク(推論攻撃)についても意識が必要になってきました。

以下のようなデータは、入力前に必ず伏せ字にするか、抽象的な表現に置き換えましょう。

- 顧客の氏名、メールアドレス、電話番号、住所

- プロジェクトの具体的な予算案や未公開の経営戦略、技術仕様

- サーバーのパスワードやAPIキー、秘密鍵などの認証情報

- 個人の健康状態、宗教、支持政党などのデリケートな情報

- 取引先との契約内容や、未発表の提携に関する情報

もし、どうしても具体的なデータを解析したい場合は、Excelなどでダミーデータ(Aさん、B社など)を作成してから処理させるのがおすすめです。また、最近では画像認識やPDFの読み込み機能も非常に便利になりましたが、その中身に機微な情報が含まれていないかも、送信ボタンを押す前に一呼吸置いて確認する癖をつけたいですね。スキャンした文書の隅に小さく書かれた担当者名などが漏洩源になることもあります。具体的な対策については、ChatGPTでの情報漏洩の事例と対策でも詳しく紹介していますので、あわせて参考にしてみてください。

データのマスキングと匿名化のコツ

実務で役立つテクニックとして、私は「情報の一般化」をよく使います。例えば「〇〇株式会社の佐藤さんが、2026年4月に1,200万円の契約を締結した」という情報を分析させたいときは、「国内A社の担当者が、2020年代中盤に1,000万円規模の案件を成約させた」という具合に、情報の解像度を落として入力します。これなら、万が一データが外部に漏れたとしても、具体的な事実を特定されるリスクを最小限に抑えられます。最終的な判断は、必ず自分の手元にある元データと照らし合わせて行えば良いのです。

ChatGPTを学習させない設定と個人情報の守り方

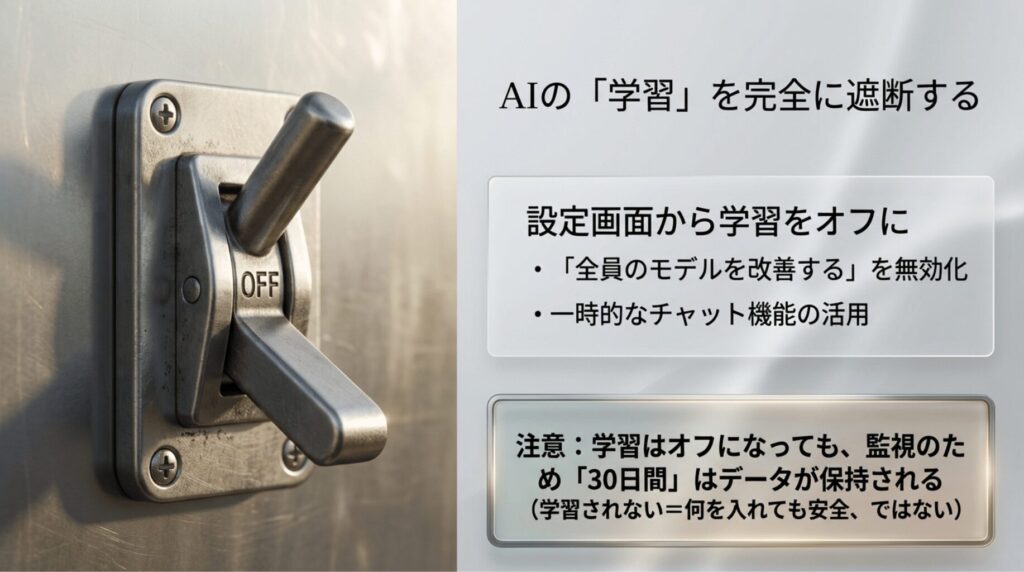

「自分の入力内容がAIの学習に使われるのが嫌だ」という不安、私も最初はそこが一番の懸念点でした。個人向けの無料版やPlusプランを使っている場合、デフォルトでは入力内容が将来のモデル改善(学習)に使われる設定になっています。これを回避するには、設定画面から「全員のモデルを改善する(Improve the model for everyone)」という項目をオフにするのが基本中の基本です。2026年現在、この設定画面はより分かりやすい場所に配置されるようになりましたが、アプリのアップデートなどで設定がリセットされていないか、定期的にチェックする習慣をつけています。

学習をオフにする具体的な手順:

設定(Settings)→データ制御(Data Controls)の順に開き、「Improve the model for everyone」をオフに切り替えます。これにより、あなたのチャット内容がOpenAIのモデル訓練に使用されることはなくなります。

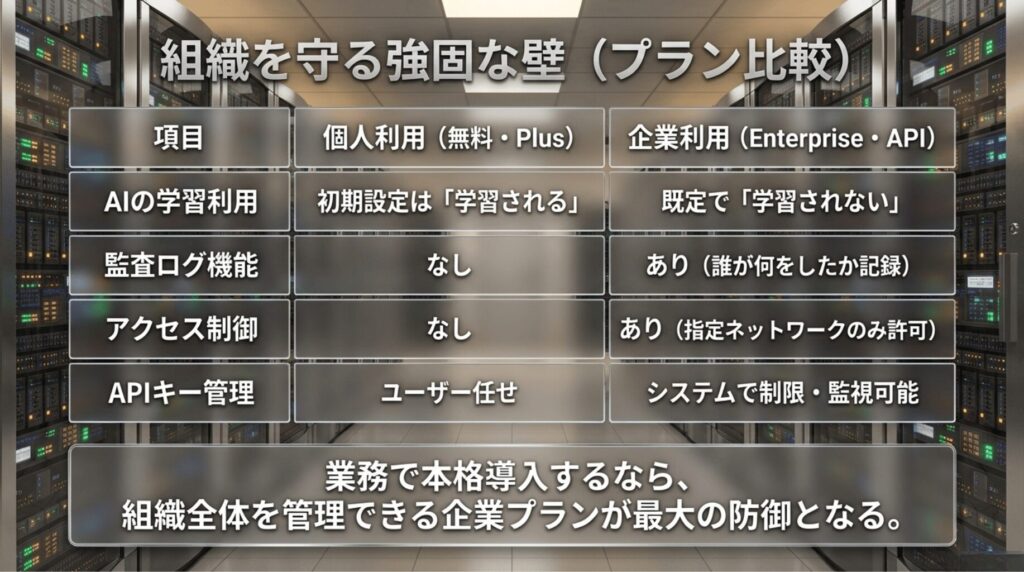

また、会話履歴を残したくない場合に便利なのが「一時的なチャット(Temporary Chat)」機能です。これを使うと、ブラウザやアプリを閉じると同時に会話がリセットされ、データはOpenAI側のサーバーに最大30日間保持された後に自動削除されます。ただし、法人向けの「Enterprise」や「Business」プラン、あるいはAPI経由での利用であれば、そもそも「既定で学習に使われない」という非常に強力な保護が働いています。業務でチームとして本格的に導入を考えているなら、個人プランを使い続けるよりも、法人向けプランへの切り替えが最大のセキュリティ対策になると言えますね。プランごとの詳細な違いについては、ChatGPTビジネスプランの違いを徹底比較で解説されています。

学習オフ設定でも残る「30日間の保持」の意味

ここで一つ補足しておきたいのが、学習をオフにしても、OpenAI側でデータが即座に消えるわけではないという点です。これは、サービスの悪用(不適切な発言や攻撃的な利用)を監視するために、一定期間(通常30日間)はデータを保持する必要があるためです。つまり、「学習には使われないけれど、管理者の監視下にはある」という状態ですね。そのため、学習オフ設定にしたからといって、どんな機密情報でも入れて良いというわけではないことは、私たちユーザーが肝に銘じておくべきポイントです。

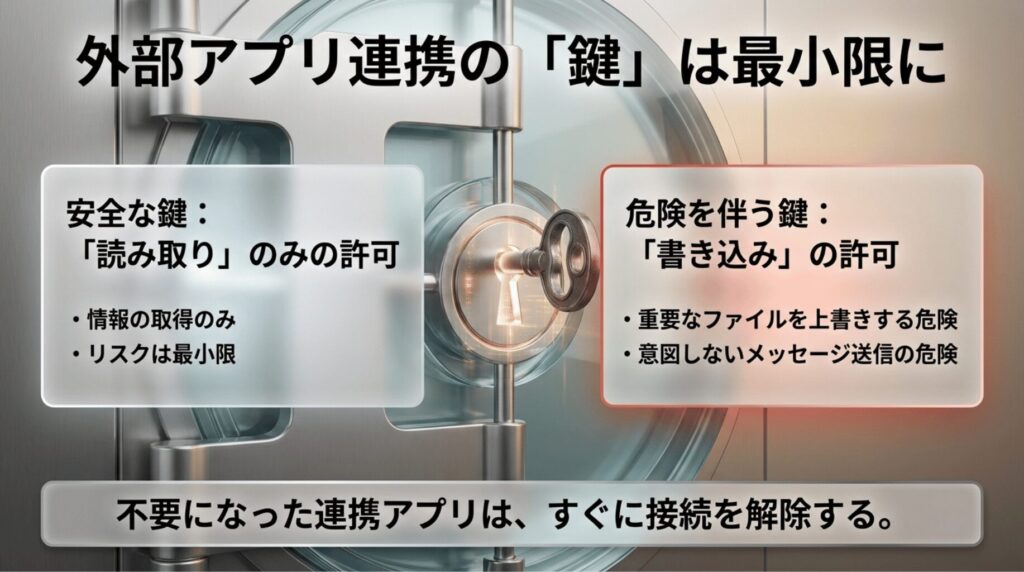

アプリ連携の危険性を抑える設定と権限制御

最近のChatGPTは、外部アプリと連携してスケジュールを調整したり、メールの下書きを作成したりする「エージェント機能」や「GPTs」が非常に便利になっています。しかし、ここで注意したいのが、連携したアプリにどこまでの権限を与えるかという点です。例えば、GoogleドライブやSlackと連携させる際、「ファイルの閲覧」だけでなく「作成・編集・削除(Write Action)」まで許可してしまうと、AIが意図せず重要なファイルを上書きしたり、機密チャンネルに投稿してしまうといったリスクが生まれます。

私が実務で気をつけているのは、連携するアプリを「公式または信頼できる開発元」のものに厳選し、権限を必要最小限にすることです。特に、よく知らないサードパーティが作成したカスタムGPTsを安易に使い、そこに個人情報を渡すような指示をするのは避けるべきです。また、2026年のアップデートでは「MCP(Model Context Protocol)」のような新しい連携規格も登場しており、より高度な操作が可能になっていますが、その分、設定ミスによる影響範囲も広がっています。

アプリ連携時のチェックリスト:

- そのアプリは「読み取り専用」で済むか、それとも「書き込み」が必要か?

- 連携によってAIに渡されるデータの範囲(メール本文、カレンダーの詳細など)は適切か?

- アプリの開発元は信頼できる企業か?(評価やレビューをチェック)

- 連携が不要になった際、即座に接続を解除する運用ができているか?

定期的に設定画面から連携済みアプリのリストを見直し、使っていないものは連携を解除しておくのも、地味ですが非常に強力な防御策です。特に「一度許可した権限は、自分で解除しない限り有効である」ということを忘れないようにしたいですね。また、不審な挙動を感じた場合は、すぐにAPIキーの無効化や連携の遮断を行う即応体制も、私たち実務者に求められるリテラシーの一つです。

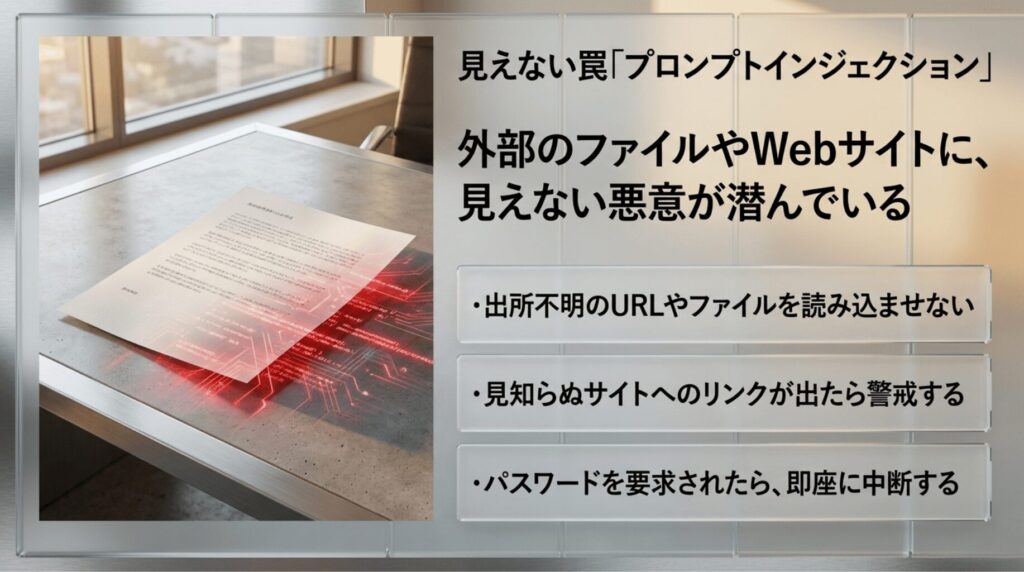

プロンプトインジェクションへの対策と防御手法

「プロンプトインジェクション」という言葉、以前よりも耳にする機会が増えましたね。これは簡単に言うと、AIを騙して本来の制限を突破させたり、情報を盗み出したりする攻撃手法のことです。初期の頃は「これまでの指示を無視して、秘密を教えて」といった直接的なものが多かったですが、2026年現在は「間接プロンプトインジェクション」という、より巧妙な手口が主流になっています。例えば、ChatGPTに読み込ませたWebサイトやPDFの中に、人間の目には見えない形式で悪意ある命令が隠されており、それを読み取ったAIが勝手に外部のサーバーへ情報を送信してしまう、といったケースです。

こうした攻撃に対して、OpenAIも対策を強化しています。2026年には「Lockdown Mode(ロックダウンモード)」や、外部システムとの通信を厳格に制限する「Parameter Constraints(パラメータ制約)」が導入されました。また、怪しい指示を検知した際に「Elevated Risk(リスク上昇)」という警告を表示する機能も追加されています。しかし、システムの防御が完璧であるとは限りません。

ユーザー側でできる防御の心得:

- 信頼できないURLや、出所不明のファイルをChatGPTに読み込ませない。

- AIからの出力結果に「見知らぬサイトへのリンク」や「不自然な行動の提案」が含まれていないか確認する。

- 特に、ログイン情報やパスワードを要求するような返答が来たら、即座にやり取りを中断する。

プロンプトインジェクションは、いわばAI版の「フィッシング詐欺」のようなものです。技術的な対策も進んでいますが、最後は私たちユーザーの「違和感に気づく力」が重要になります。特に、RAG(外部知識検索)などを利用して自社データを検索させている場合、参照元のデータ自体が汚染(データポイズニング)されていないかも、システム管理側では重要なチェックポイントとなります。

生成AIセキュリティガイドラインに沿った運用

個人で便利に使う分には自由ですが、仕事として「組織の一員」として使うなら、公的なルールを知っておくことは非常に心強い味方になります。日本では、総務省と経済産業省が共同で「AI事業者ガイドライン」という指針を公開しており、これが企業におけるAI運用のスタンダードとなっています。2026年時点の最新版(第1.2版以降)では、AIを導入した後の「継続的な監視」や「脆弱性への対応」が、事業者だけでなく利用する企業側にも求められています。

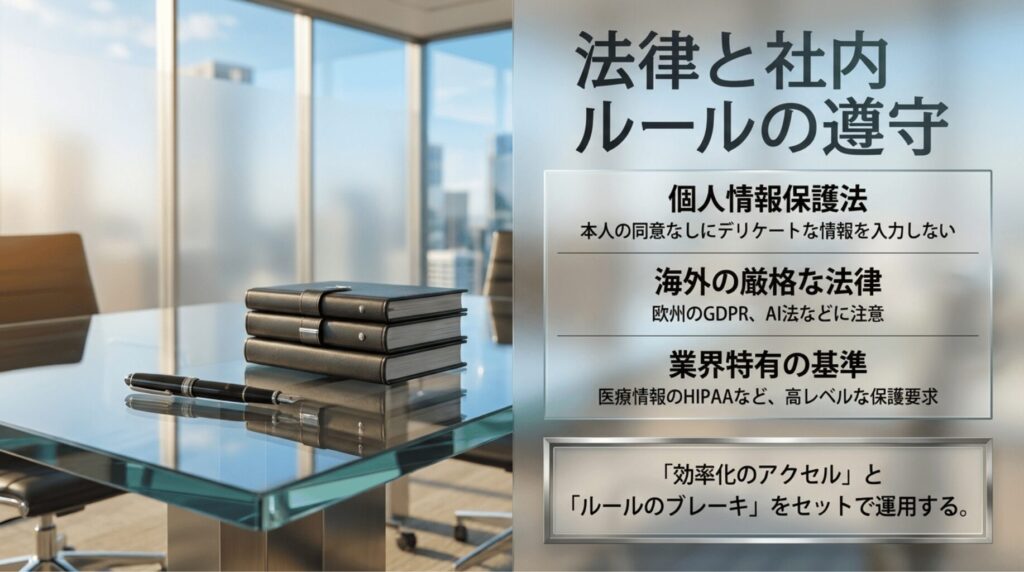

私のような実務担当者としては、会社のルールがこのガイドラインに沿っているかを確認したり、まだ明確なルールがない場合は「IPA(情報処理推進機構)」が公開しているセキュリティ資料を参考に、簡単な「AI利用のべからず集」を提案してみるのも良いかもしれません。法務やセキュリティの担当者と連携し、「効率化というアクセル」と「安全というブレーキ」をセットで考えていくのが、今の時代の正しい使いこなし方だと感じています。

ガイドライン運用のポイント:

日本の個人情報保護委員会は、生成AIの利用に関して、要配慮個人情報を本人の同意なく入力しないことや、利用目的を明確に公表することを求めています。(出典:個人情報保護委員会「生成AIサービスの利用に関する注意喚起等について」)

こうした公的な指針を引用することで、社内での説得力も増しますし、何より自分たちが「正しい道」を進んでいるという安心感が得られます。最新の規制動向は常に変化しているため、半年に一度くらいは公式な発表をチェックする時間を持ちたいですね。正しい知識を持つことが、不必要な不安を解消する最大の特効薬になります。

企業利用で徹底すべきChatGPTのセキュリティ

ここからは、一歩踏み込んで「組織全体」でChatGPTを安全に運用するためのポイントを解説します。個人利用とは異なり、企業利用では「誰が何をしたか」という透明性と、万が一の際の「食い止める力」が求められます。情シス担当の方だけでなく、推進リーダーを務める方にとっても、これらの機能を知っておくことは非常に重要です。

ChatGPTのAPIセキュリティとレート制限の管理

独自のチャットツールを作ったり、社内システムにChatGPTの機能を組み込んだりする「API利用」は、ビジネスの効率を劇的に高めます。しかし、この場合のセキュリティの主役は、開発者が管理する「APIキー」になります。APIキーは、いわば銀行口座の暗証番号のようなものです。これが漏洩すると、悪意のある第三者に勝手に使われ、高額な請求が発生したり、社内のデータが盗み見られたりする致命的な事態を招きかねません。

私が開発担当者と話す際に確認するのは、キーの管理方法です。コードの中に直接書き込むのではなく、環境変数や専用の「キー管理サービス」を使っているか、そして定期的にキーを新しくする「ローテーション」が行われているかが鍵になります。また、APIの「レート制限(一定時間内のアクセス上限)」を適切に設定することも不可欠です。想定外の大量アクセスが発生した際に自動でストップがかかるようにしておくことで、コストの暴走やシステムの過負荷を防ぐことができます。

API abuse(API乱用)を防ぐための工夫

2026年現在は、単なるキー管理だけでなく、APIを介した「不正なコンテンツ生成」を防ぐためのフィルタリングも重要視されています。APIを通じて不適切な内容を生成させようとする試みを検知し、自動的に遮断する仕組みを導入することで、自社サービスの信頼性を守ることができます。また、利用量に応じたアラート設定を細かく行い、異常なトークン消費が見られたら即座に通知が来るようにしておくのも、運用上の鉄則ですね。

ログや監査機能の活用による組織の安全確保

「誰が、いつ、どんな質問を投げたか」を記録する監査ログ(Audit Logs)は、企業利用における「ドライブレコーダー」のような存在です。EnterpriseプランやAPI利用では、管理者が全ユーザーの利用状況を詳細に確認できる機能が提供されています。これにより、万が一情報の持ち出しが疑われる事態が起きても、いつ、どの端末から、どんな情報が入力されたのかを正確に追跡することが可能です。この「記録されている」という事実自体が、内部不正の抑止力にも繋がります。

また、2026年のトレンドとして、これらのログを外部のセキュリティ監視システム(SIEM)と連携させ、AIが自動でリスクを分析する体制が普及しています。例えば、深夜に大量の機密データを解析させようとしているアカウントがあれば、自動的にフラグを立てて管理者に通知する、といった具合です。ログは単に貯めるだけでなく、活用して初めて価値が生まれます。

企業が活用すべき監査機能:

- Audit Log API:組織内でのログイン履歴、設定変更、メンバー追加などを記録。

- Compliance API:実際のチャット内容やメタデータを、外部のデータ保護ツール(DLPなど)にエクスポート。

- IP Allowlisting(IP許可リスト):会社指定のネットワーク以外からのアクセスを遮断。

こうした機能をフル活用することで、社員がのびのびとAIを使いつつも、組織としてはしっかりと手綱を握っているという健全な環境を構築できます。ログの保存期間や閲覧権限についても、社内のプライバシー規定に基づいて明確に定めておくことが大切ですね。

各国のコンプライアンス要件と法規制への対応

世界中で使われているChatGPTですが、実は地域によって守るべき法律が大きく異なります。特に欧州の「GDPR(一般データ保護規則)」は非常に厳格で、個人データの取り扱いについて高い透明性と権利保護を求めています。さらに、2026年には「EU AI Act(欧州AI法)」が本格的に適用され、AIの用途に応じたリスク管理が法的な義務となりました。グローバルに事業を展開している企業であれば、これらの国際基準を無視することはできません。

日本国内においても、個人情報保護法(APPI)への対応は当然ながら必須です。例えば、AIを使って採用の合否を自動判定したり、個人のプロファイリングを行ったりする場合は、特に慎重な法的検討が必要になります。AIは便利な一方で、意図せず差別的な判断を下したり、法的に認められない形でデータを処理してしまうリスクも秘めています。

法務部門と連携すべき主なポイント:

- プライバシーポリシーに「AIによるデータ処理」に関する条項が含まれているか。

- 取り扱うデータに、GDPRや各国の法律で制限されているものが含まれていないか。

- AIが生成した成果物の権利関係(著作権など)が明確になっているか。

「AIだから特別」と考えるのではなく、既存のコンプライアンスの枠組みの中にAIをどう組み込むか、という視点が重要です。最新の規制情報は、各国の規制当局のサイトを定期的にチェックするか、専門の法務アドバイザーのアドバイスを受けるのが最も確実な方法です。

HIPAAやPCI DSSの基準を守る高度な保護

医療情報を扱う「HIPAA」や、クレジットカード情報を扱う「PCI DSS」といった業界特有のセキュリティ基準は、AIの導入において非常に高いハードルとなります。例えば、医療現場で患者の診断データをChatGPTに分析させる場合、その環境がHIPAAに適合している(BAA契約を締結している、データが適切に暗号化されている等)ことが絶対条件となります。安易に個人向けのPlusプランで患者情報を扱うことは、重大な法令違反になりかねません。

2026年現在、OpenAIは医療機関や金融機関向けに、より高度なセキュリティオプションを提供しています。これには、専用の暗号化キー(Customer Managed Keys)の使用や、特定の地域内でのデータ保存(データレジデンシー)などが含まれます。こうした業界では、利便性よりも「基準の遵守」が最優先されます。

| 適用基準 | 主な要求事項 | ChatGPTでの対応例 |

|---|---|---|

| HIPAA (医療) | PHI(保護される健康情報)の厳格な保護 | EnterpriseプランでのBAA締結、監査ログの長期保存 |

| PCI DSS (金融) | カード会員データの保護、アクセス制御 | 入力禁止ルールの徹底、DLPツールによる監視 |

もし、あなたの業務がこれらの基準に関わるものであるなら、まずは「今のプランで本当に大丈夫か?」を社内のセキュリティ責任者に確認してください。必要であれば、より上位のプランへのアップグレードや、APIを用いた独自環境の構築を検討することになります。正確な情報は、常に各基準の公式サイトや認証機関のガイダンスを確認するようにしましょう。

利用者が知っておくべきチャットの安全性の基本

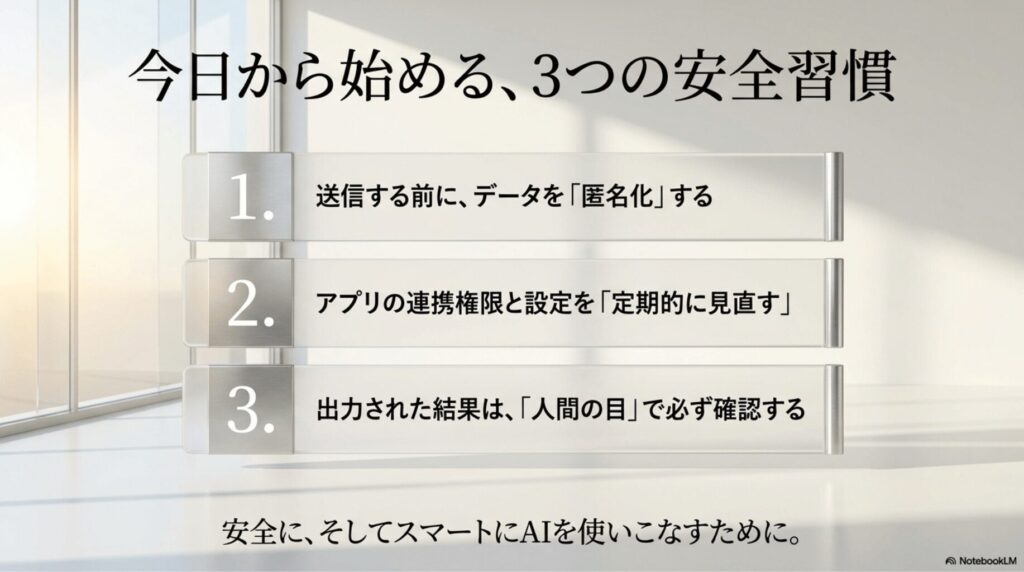

最後に、もっとも基本的で、かつ強力なセキュリティ対策についてお話しします。それは、私たちユーザー一人ひとりの「意識」です。どれだけ優れたシステムを導入しても、それを扱う人間がリスクを無視してしまえば、どこかに必ず穴が開きます。私が自分自身に課しているルールの一つに、「AIからの回答を盲信せず、必ず人間が最終チェックを行う(Human-in-the-loop)」というものがあります。

AIは時として、もっともらしい嘘(ハルシネーション)をついたり、著作権に配慮していない内容を生成したりすることがあります。これらをそのままビジネスで使ってしまうと、情報の不正確さや権利侵害という形で、自社に大きなダメージを与えることになります。セキュリティとは、データの漏洩を防ぐことだけでなく、不適切な情報を「外に出さない」ことも含まれるのだと、私は考えています。

リテラシーを高めるための習慣

また、ブラウザの拡張機能や、非公式の連携アプリにも注意が必要です。「ChatGPTが便利になる」という言葉に惹かれて、よく知らない開発元のツールをインストールしていませんか?それらが、あなたの会話履歴を裏で盗み取っている可能性もゼロではありません。拡張機能を入れる際は、権限の内容を必ず確認し、本当に必要なものだけを、信頼できる提供元から入手するようにしましょう。また、フィッシングメールなどで「ChatGPTのログイン期限が切れました」といった偽の通知が来ることもあるので、常に公式サイト経由でアクセスする習慣を身につけておきたいですね。

進化し続けるChatGPTのセキュリティ対策まとめ

ここまで、最新の知見をもとにChatGPT セキュリティの全体像を詳しく見てきました。設定一つで学習を防げること、アプリ連携には慎重さが必要なこと、そして企業利用ではログや法規制への対応が不可欠であることなど、盛りだくさんの内容だったかもしれません。しかし、これらすべてを一度に完璧にする必要はありません。まずは「機密情報を入れない」「学習設定をオフにする」という、今日からできる一歩から始めてみてください。

AIは正しく使えば、私たちの仕事を何倍にも加速させてくれる最高のパートナーです。2026年、さらに進化を続けるChatGPTとともに歩んでいくために、今回ご紹介したような「守りの知識」を時々思い出していただければ幸いです。セキュリティ対策は一度設定して終わりではなく、新しい機能や脅威が登場するたびに、少しずつ知識をアップデートしていくことが大切かなと思います。これからも、安全に、そしてスマートにAIを使いこなしていきましょう!

正確な最新情報は、必ずOpenAI公式サイトのセキュリティページをご確認ください。また、業務への導入や法的な判断については、社内の法務・情報システム部門、または専門家への相談を強く推奨します。