日々の業務で発生する会議やインタビューの録音、これを手作業で文字に起こすのは本当に骨が折れますよね。私もバックオフィスや企画の仕事をする中で、どうにかしてこの時間を短縮できないかと、さまざまなツールを試してきました。最近ではAI技術が驚くほど進化していて、文字起こしの精度が高いサービスが増えていますが、いざ選ぼうとすると選択肢が多すぎて迷ってしまうことも多いかなと思います。

日本語の文字起こし精度については、単にどれが良いというだけでなく、音声認識のAPI比較をしたり、話者分離ができるかといった機能面を見たり、会議の議事録を自動作成する際の運用コストを考えたりする必要があります。また、社外秘の情報を扱う場合には文字起こしのセキュリティ面も無視できません。この記事では、私が実務を通じて感じた視点から、皆さんの業務に最適なツールを見つけるためのヒントをお伝えできればと思います。

- 日本語特有の誤認識を避けるための精度指標の読み解き方

- API組み込み型とUI重視型のツールの使い分けポイント

- 固有名詞や業界用語に強いサービスを選ぶための基準

- 企業のガバナンスに適合するデータ保持方針とセキュリティ

文字起こしの精度が高いサービスの比較方法

「このツールは精度99%です!」といった広告をよく見かけますが、実際に使ってみると「あれ?」と思うこと、ありますよね。まずは、私たちユーザーが何を基準に精度を判断すればいいのか、実務的な視点で整理してみることにしましょう。カタログスペックだけでは見えてこない、現場での使い勝手を左右する要素を解説しますね。

WERやCERとは何か?精度の定義を解説

文字起こしの精度を語る際によく出てくるのが、WER(単語誤り率)とCER(文字誤り率)という指標です。WERは英語などの単語をスペースで区切る言語でよく使われ、CERは日本語のように文字が連続する言語で重視されることが多いかなと思います。精度の高い比較を行うためには、まずこの数値の成り立ちを知っておくのが近道です。

WER(Word Error Rate)の仕組み

WERは、AIが起こした文章が「正解の文章」からどれだけズレているかを算出する世界標準の指標です。具体的には、以下の数式で計算されます。

$$WER = \frac{S + D + I}{N}$$

ここで、$S$は置換(間違った単語)、$D$は削除(抜けてしまった単語)、$I$は挿入(余計に入った単語)、そして$N$は正解文の総単語数です。この数値が低いほど、精度が高いということになります。最近のベンチマーク(例えばArtificial Analysisのデータなど)では、OpenAIやAssemblyAI、Speechmaticsなどが3.2%〜4.3%といった非常に低いWERを記録しており、英語圏ではすでに人間レベルに近い精度に達していると言われています。

日本語で重要なCER(Character Error Rate)

一方で、日本語は英語のように単語間にスペースがないため、単語の区切り方(分かち書き)のルールによってWERの数値が変動しやすいという弱点があります。そこで役立つのが、文字単位で間違いを計算するCERです。漢字一文字、カナ一文字単位で評価するため、私たち日本人がパッと文章を見たときの「正確さ」の実感に非常に近い指標と言えます。「文字起こしの精度が高い」と謳うサービスを比較する際は、単にWERだけでなく、日本語専用のテストセットでCERがどれくらいなのかを注視するのが、実務上のコツかなと思います。

精度の数値を読み解く際の注意点

- メーカー公称の「99%」は、ノイズのないスタジオ録音など、理想的な条件下での数値であることが多い

- WERは全体の文脈の正確さを、CERは一文字ずつの正確さを表す

- 数値が良くても、固有名詞や同音異義語に弱い場合がある

ただし、これらの数値はあくまで一般的な目安として捉えてくださいね。実際の会議では、話し手の滑舌やマイクの性能、周囲のガヤガヤした音など、数値化しにくい要素が山ほどあります。最終的な判断は、各サービスの無料トライアルなどを活用して、実際の業務で使う録音データで試してみることを強くおすすめします。

日本語の文字起こし精度に影響する要因

日本語は、世界的に見ても音声認識が難しい言語の一つだと言われています。その最大の理由は、音は同じでも意味が異なる「同音異義語」の多さにあります。例えば「こうしょう」という音だけでも、ビジネスシーンでは「交渉」「高尚」「考証」「公証」など、文脈によって正解が全く異なります。精度の高いサービスは、単に音を拾うだけでなく、前後の文章から「今はビジネスの話し合いだから『交渉』が正解だろう」と推測する能力に長けています。

表記揺れと数字の扱い

また、表記揺れも大きな課題です。「1,200万円」を「千二百万円」と書くのか、「1200万円」とするのか。あるいは「A/Bテスト」を「エービーテスト」とカタカナで起こしてしまうのか。こうした細かい整形能力が、後で読み返すときのストレスに直結します。企画職の方なら、数字がバラバラだと資料にまとめる際に二度手間になってしまいますよね。

精度が急激に落ちる典型的なシーン

- 話し手の被り:二人以上の人が同時に話すと、AIは音の分離ができず支離滅裂な文章になりやすい

- 専門用語の多用:業界特有の略語や社内用語は、一般的なAIモデルでは学習されていないことが多い

- フィラー(えー、あのー):これらを適切に除去できないと、非常に読みにくい文章になる

最近の文字起こしサービスでは、これらの弱点を克服するために、ディープラーニングを用いた高度なノイズキャンセリングや、特定の業界用語を事前に学習させる「アダプテーション(適応)」機能が強化されています。例えば、建築現場の騒音の中での会話や、専門用語が飛び交うエンジニア同士のMTGなど、自分の職場の環境がどれに近いかを考えてサービスを比較すると、失敗が少なくなりますよ。

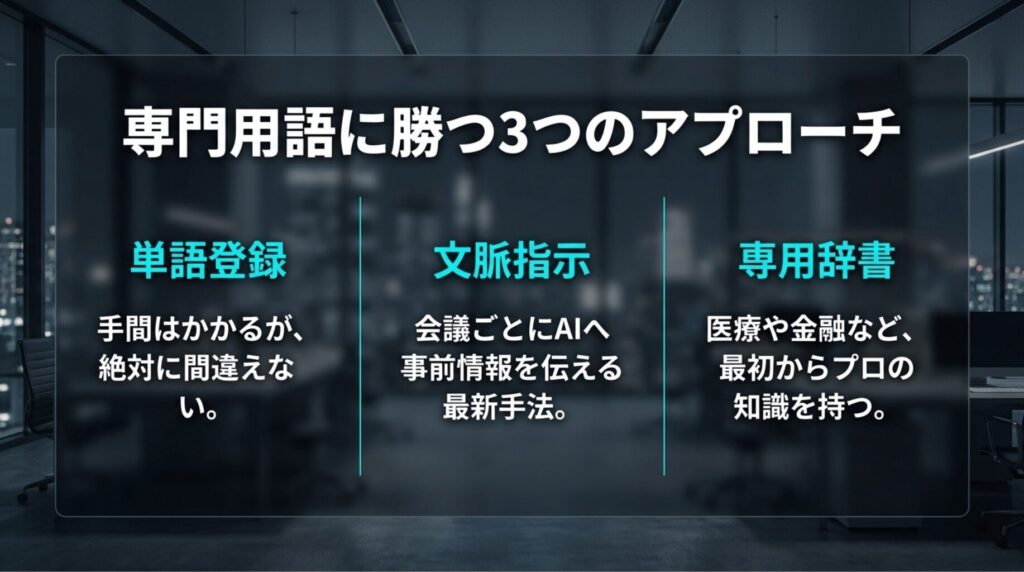

固有名詞に強い文字起こしサービスの選び方

実務で一番困るのは、大事なクライアント名や自社製品の名前が間違って変換されることですよね。「株式会社〇〇」が「株式会社マルマル」ならまだしも、全く別の言葉に変換されてしまうと、後からの検索性も悪くなってしまいます。こうした固有名詞への強さを測るには、そのサービスに「単語登録機能」や「プロンプト機能」があるかを確認するのが一番です。

国内勢の強み:AmiVoice

日本国内で長年の実績がある「AmiVoice」は、日本語の専門用語に非常に強いことで知られています。医療、金融、保険といった特定の業界に最適化されたエンジンを持っており、人名や地名などの固有名詞の認識率が非常に高いのが特徴です。バックオフィスで契約書の確認や、正確な記録が求められる部署には、こうした「日本語特化型」のサービスが心強い味方になりますね。

最新AIの強み:プロンプトによる文脈補強

一方で、OpenAIのWhisper系モデルやAssemblyAIなどは、認識を開始する前に「この会議では、次世代プロジェクトの『アルファ計画』について議論します」といった補足情報をプロンプトとして渡すことができます。これにより、AIが「アルファ」という音を聞いたときに、優先的にその漢字や綴りを当てはめてくれるようになります。これは最新のAIモデルならではの柔軟なアプローチですね。

| 対策アプローチ | 代表的なサービス | メリット | デメリット |

|---|---|---|---|

| ユーザー辞書・単語登録 | AmiVoice, Azure Speech | 登録した単語は確実に認識される | 事前の登録作業に手間がかかる |

| コンテキスト(プロンプト) | OpenAI API, AssemblyAI | 会議ごとに柔軟に設定を変えられる | 設定が不適切だと効果が薄い |

| 業界別専用エンジン | Google Cloud, AmiVoice | 最初から高い精度が期待できる | 対象外の業界では効果が低い |

もし皆さんの仕事が、特定の専門用語が頻出するものなら、辞書登録ができるサービスを選びましょう。逆に、毎回異なるトピックの取材や会議を行うなら、プロンプトで文脈を伝えられる最新のAPI型サービスを検討するのが良いかなと思います。各サービスの詳細は公式サイトをご確認いただき、ご自身の業務フローに合う方を選んでくださいね。

話者分離の文字起こしで会議の質を高める

複数人が参加する会議の文字起こしにおいて、「誰が言ったか」を判別する話者分離(ダイアリゼーション)機能は、もはや必須と言っても過言ではありません。後で振り返ったときに、上司の発言なのか、クライアントの要望なのかが混ざってしまっていると、議事録としての価値が半減してしまいますよね。

ダイアリゼーションの精度を分けるもの

実は、音声認識そのものの精度と、この話者分離の精度は別物です。話者分離は、声の周波数や話すタイミングを分析して、複数の「声の指紋」を特定する技術です。最近のAzure AI SpeechやAmazon Transcribeなどのクラウドサービスでは、最大30〜35人までの話者を識別できるモデルも登場しており、大人数のワークショップなどでも活用できるようになっています。私が企画の仕事で20名規模のブレインストーミングを録音した際も、こうしたクラウド系の話者分離機能には本当に助けられました。

運用面での使い勝手

一方で、技術的な精度だけでなく「編集のしやすさ」も重要です。例えばNottaやCLOVA Noteなどのサービスは、分離された話者ごとにアイコンを表示し、後からワンクリックで「話者A」を「佐藤部長」に一括置換できるような工夫がされています。こうしたUIの工夫こそが、実務者の負担を減らす大きなポイントになります。

話者分離を成功させるコツ

AIの精度を過信せず、可能であれば会議の冒頭で一人ずつ自己紹介をしてもらうのがおすすめです。AIが最初にそれぞれの声の特徴を掴みやすくなり、その後の分離精度が目に見えて向上することがありますよ。

話者分離の精度は、録音したマイクの品質(ステレオ録音かモノラル録音か)にも大きく左右されます。正確な仕様や推奨される録音環境については、必ず各サービスの公式ヘルプページを確認するようにしましょう。適切なツールを選べば、これまで1時間かかっていた会議の振り返りが、わずか15分で終わるようになるかもしれません。

会議の議事録を自動作成するツールの活用法

さて、文字起こしが完了した後、そのテキストを「使える議事録」にするプロセスこそが、私たちの腕の見せ所です。最近では、文字起こし機能そのものよりも、その後の「要約」や「ネクストアクションの抽出」に特化したサービスが人気を集めていますね。

AI要約機能の進化

例えば、NottaやTrintといったツールは、文字起こしされた長大なテキストを数行の要約にまとめてくれます。「結局、今日の会議で何が決まったんだっけ?」という問いに対して、AIが箇条書きで即座に回答してくれるのは、スピード感が求められるWeb業務や企画の現場では非常に強力な武器になります。ChatGPTなどの生成AIと連携させることで、議事録のトーンを「報告書風」や「チャット共有用」に書き分けることも可能になっています。

実務に役立つワークフローの構築

私が実践している方法としては、まずはAIに全文を書き出させ、重要なポイントだけを人間がチェックするというスタイルです。AIは完璧ではありませんが、「何もないところから書く」より「下書きを修正する」方が圧倒的に楽だからです。この「AI 8割:人間 2割」のバランスを保つことが、継続的な業務効率化の秘訣かなと思っています。

| 機能名 | 実務でのメリット | 代表的なツール |

|---|---|---|

| 自動要約 | 会議の要点を数分で把握できる | Notta, ChatGPT連携ツール |

| タイムスタンプ | 特定の箇所の録音をすぐに聞き直せる | Sonix, Trint |

| 共有・コメント | チームメンバーと共同で議事録を修正できる | Notta, Otter |

| 外部連携 | SlackやNotionに自動で議事録を送れる | CLOVA Note, Zapier連携サービス |

ただし、AIが作成した要約に事実誤認が含まれていないか、数値や期限などは必ず人間の目で最終確認をしてくださいね。最終的な議事録の正確性は、作成者の責任となりますので、ツールはあくまで「強力な補助」として活用するのが誠実な仕事の進め方だと思います。

Whisperの比較で見る汎用モデルの実力

ここ数年で音声認識の常識を塗り替えたのが、OpenAIが開発した「Whisper」です。このモデルの凄さは、とにかく「日本語の自然な会話」に対する認識力の高さにあります。従来のシステムが苦手としていた、ボソボソとした話し声や、少し早口な議論でも、驚くほど正確にテキスト化してくれます。

Whisperの各サイズと精度の違い

Whisperには「tiny」「base」「small」「medium」「large」といった複数のサイズがあり、さらに最新の「large-v3」や「large-v3-turbo」といった改良版も出ています。サイズが大きくなるほど認識精度は上がりますが、その分処理に時間がかかるというトレードオフがあります。実務で使うAPIサービスやアプリが、どのモデルを採用しているかを知ることは、精度を比較する上での大きなヒントになります。

実務者がWhisperを使うメリット

私が実際に使ってみて感じたのは、Whisperは「文脈を理解する力」が非常に強いということです。単なる音の置き換えではなく、文章としての整合性を保とうとするため、読みやすいテキストが生成されやすいのです。また、多言語対応も優れており、日本語と英語が混ざるような外資系企業やグローバルプロジェクトの会議でも、言語を自動で判別して文字起こししてくれるのが助かりますね。

Whisper活用時のポイント

- モデルのサイズによって精度とスピードが変わる

- プロンプト機能を併用することで、専門用語の認識をさらに高められる

- API経由であれば、入力データが学習に利用されない設定が可能

このようにWhisperは非常に強力ですが、全ての面で万能というわけではありません。例えば、リアルタイムでの文字起こし(ストリーミング認識)には、Deepgramのような専用エンジンの方が向いている場合もあります。最新のAI技術に興味がある方は、まずWhisperを搭載したアプリ(Nottaなど)から試してみるのが、その実力を体感する一番良い方法かもしれません。最新のアップデート情報については、OpenAIの公式ブログなどで常にチェックしておきたいところですね。

目的別で見る文字起こしの精度が高い比較基準

「精度が高い」という言葉の裏には、実はさまざまなニーズが隠れています。エンジニアの方が自社のアプリに組み込みたい場合と、私のような企画担当者が「今日の会議の内容をすぐ共有したい」という場合では、選ぶべきツールが全く異なるからです。ここでは、皆さんの利用シーンに合わせた最適なサービス選びの基準を、より踏み込んで整理してみましょう。

音声認識のAPI比較で見る開発の選択肢

もし皆さんが、社内ツールや自社サービスに文字起こし機能を組み込みたいと考えているなら、UI(画面)の使いやすさよりもAPIの安定性や柔軟性、そしてコストパフォーマンスを重視した「音声認識のAPI比較」が重要になります。開発者向けのAPI型サービスは、大量の音声ファイルを自動で処理したり、リアルタイムで字幕を表示したりする際に、その真価を発揮します。

主要なAPIプロバイダーの傾向

世界的に見ると、OpenAIの「Whisper API」は非常に有名ですが、それ以外にも強力なライバルがひしめき合っています。例えば、AssemblyAIは、文字起こしだけでなく「感情分析」や「要約」といったAI機能を一つのAPIで提供しており、開発の手間を大幅に減らしてくれます。また、Deepgramは、独自の深層学習モデルによって「圧倒的な処理速度」を実現しており、数時間の音声をわずか数分でテキスト化できるスピード感が魅力です。さらに、Speechmaticsは、世界中の多種多様なアクセント(訛り)に対しても高い精度を維持することに定評があり、グローバル展開を視野に入れたプロジェクトには欠かせない選択肢となっています。

| プロバイダー名 | 強み・特徴 | 主な用途 |

|---|---|---|

| OpenAI Audio API | Whisperベースの圧倒的な文章構成力 | 汎用的な文字起こし、翻訳連携 |

| Deepgram | 驚異的な処理スピードと低レイテンシ | リアルタイム字幕、大量バッチ処理 |

| AssemblyAI | 音声データからのインサイト抽出に強い | コールセンター分析、コンテンツ要約 |

| Speechmatics | 多言語・多アクセントへの適応力 | 放送メディア、グローバル会議 |

APIを選ぶ際のもう一つのポイントは、「従量課金の単価」です。1分あたり数円の違いでも、月間に数万時間の音声を処理するとなると大きなコスト差になります。また、ストリーミング(リアルタイム)認識が必要な場合は、WebSocketなどのプロトコルに対応しているかどうかも確認が必要です。最新のAPI性能については、提供元のアップデート頻度が非常に高いため、各社の「API Documentation」を定期的にチェックすることを強くおすすめします。技術的な選定については、社内のエンジニアの方と相談しながら、実際に数分程度の音声ファイルを投げてレスポンスや精度をテストしてみるのが一番確実かなと思います。

ZoomやTeamsの文字起こし連携の重要性

Web会議が日常となった今、「Zoom Teams 文字起こし」といったキーワードで最適な連携方法を探している方も多いのではないでしょうか。会議の最中に必死でメモを取ることから解放されるためには、会議ツールと「シームレスに繋がること」が何よりの精度向上の鍵となります。単に後から録音ファイルをアップロードするのではなく、会議の進行と同時にテキスト化が進むことで、会議終了直後に議事録の初案が完成しているという理想的なワークフローが作れるからです。

ボット参加型と内蔵機能の使い分け

多くの文字起こしサービスでは、ZoomやTeamsの会議URLを登録しておくと、AIボットが「会議の参加者」として自動的に入室してくる仕組みを採用しています。この方法のメリットは、話者分離が非常に正確に行われやすいことです。誰がマイクを使って話しているかをツール側がリアルタイムで判別できるため、後からの編集作業が劇的に楽になります。対して、ZoomやTeamsに内蔵されている標準の文字起こし機能も年々進化していますが、専門用語の認識率や、外部アプリへのエクスポートの柔軟性においては、まだ専用の文字起こしサービスに一日の長があるかなと感じています。

会議ツール連携をより便利にするポイント

例えばNottaなどのツールを使えば、会議中に重要な発言があった瞬間に「タグ」を付けることができます。こうすることで、後から録音全体を聞き直さなくても、重要な部分だけをピンポイントで振り返ることが可能です。企画職の私にとっては、この「振り返りの速さ」が仕事の質を左右すると言っても過言ではありません。

ただし、会議にボットを招待する場合は、事前に他の参加者に対して「AIによる文字起こしを行います」という合意を取っておくのがマナーですね。また、社内規定によっては外部ツールの参加を制限している場合もありますので、導入前にIT部門に確認しておくことを忘れずに。詳しい設定方法については、各ツールの「連携ガイド」などを参照しながら進めてみてくださいね。こうしたツールを使いこなすことで、会議の生産性は間違いなく一段上のレベルへ引き上げられるはずです。

医療の文字起こし精度を支える専用エンジン

「医療 文字起こし 精度」という観点では、一般的なAIモデルとは全く異なる評価軸が必要になります。医療現場では、複雑な病名、薬品名、解剖学用語が頻繁に登場しますが、これらは一般的なニュースやSNSのデータで学習されたAIにとっては、最も苦手とする分野の一つだからです。もし、電子カルテの入力補助や、臨床現場でのカンファレンスの記録にAIを導入しようと考えているなら、汎用ツールではなく「医療特化型エンジン」を搭載したサービスを選ぶべきです。

なぜ専用エンジンが必要なのか?

例えば、医師が「心不全」と言ったときに、AIが「親父全員」と誤認識してしまったら、業務効率化どころか重大な事故に繋がりかねません。医療専用のエンジン(例えばAmiVoiceの医療向けプランなど)は、膨大な医学文献や症例データを学習しており、難解な専門用語を文脈に沿って正しく変換する能力が極めて高いです。また、最近では「放射線科向け」「精神科向け」など、診療科ごとにさらに細分化された辞書を持っているものもあり、その精度は驚くほど緻密です。企画やバックオフィスの視点から見ても、特定分野への専門性は、信頼を勝ち取るための最大の武器になりますね。

専門分野でツールを選ぶ際のチェックリスト

- そのサービスに「医療用語辞書」が標準搭載されているか

- ユーザーが独自の専門用語を追加で登録できるか

- 音声入力によるカルテ作成など、現場の動線に合わせたUIがあるか

もちろん、いくら専用エンジンであっても100%の精度を保証するものではありません。特に薬品名の微細な違いなどは、必ず有資格者による最終確認が必要です。医療という人命に関わる分野でAIを活用する際は、「AIはあくまでドラフト作成の補助」として位置づけ、専門家によるダブルチェックの体制を構築することが何よりも重要です。具体的な導入事例や精度向上のための活用ノウハウについては、メーカーが発行しているホワイトペーパーや、学会での報告資料などもあわせて確認されることをおすすめします。

文字起こしのセキュリティと機密保持の基準

BtoBの業務で文字起こしツールを検討する際、真っ先に議題に上がるのが「文字起こし セキュリティ」の問題です。会議の内容には、未公開の新製品情報や個人のプライバシー、企業の経営戦略など、絶対に外部に漏れてはいけない情報が含まれています。「便利だから」という理由だけで、セキュリティ基準の不明確なツールを使うのは、大きなリスクを伴います。

データの学習利用と保持方針

まず確認すべきは、「入力した音声データやテキストが、AIモデルの再学習に使われないこと」です。多くのコンシューマー向け無料ツールでは、精度向上のためにユーザーのデータを学習に利用する設定になっていることがありますが、ビジネス向けプランではこれを明示的にオフにできる、あるいは最初から学習しない契約になっていることが一般的です。また、データがサーバーにいつまで保持されるのか(保持期間の設定)や、処理が終わった瞬間にデータを削除する「Zero Data Retention」といったオプションがあるかも重要な判断材料になります。

ガバナンスと認証制度

企業のIT監査を通るためには、そのサービスがどのようなセキュリティ認証を受けているかもチェックが必要です。例えば、SOC2 Type IIやISO 27001といった国際的な認証を取得しているサービスであれば、一定の安全性が担保されていると判断できます。また、情報の取り扱いをさらに厳格にしたい場合は、クラウドではなく自社の専用サーバーやオンプレミス環境で動作する「AmiVoice Private」や「Speechmatics On-prem」といった選択肢も検討に値します。こうした専門的な選定については、ITコンサルタントや社内のセキュリティ責任者に相談しながら、慎重に進めていくのがベストですね。

安全なツール選びのための3つのキーワード

- オプトアウト(Opt-out):データの学習利用を拒否する設定があるか

- 暗号化:データ転送時(SSL/TLS)および保存時(AES-256など)に暗号化されているか

- リージョン指定:データの保存先を日本国内に限定できるか

セキュリティについては、総務省の「AI利活用ガイドライン」などでも、情報の安全な取り扱いについての指針が示されています(出典:総務省「AIネットワーク社会推進会議」)。こうした公的な情報を参考にしつつ、自社の機密レベルに見合ったサービスを選ぶことが、長期的な活用における「真の安心」に繋がるかなと思います。

文字起こしの精度が高い比較で見つける結論

ここまで、技術的な指標から目的別の選び方、さらにはセキュリティに至るまで、かなり詳しくお話ししてきました。結局のところ、「文字起こしの精度が高い比較」で見つけ出すべき正解は、一つではありません。自分の仕事が「スピード重視の議事録作成」なのか、「正確さが命の専門業務」なのか、それとも「大規模なシステム開発」なのかによって、最適解は変わってくるからです。

実務者が選ぶべき3つのルート

もし、皆さんが明日からの会議を楽にしたいと考えているなら、まずはNottaやAmiVoiceなどのUIが整ったサービスの無料版を試してみてください。日本語の自然なやり取りをどれだけスムーズに拾ってくれるか、その「体感の精度」に驚くはずです。一方で、コストを抑えつつ最高の認識力を求めるなら、OpenAIのWhisper APIをベースにしたツールを検討するのが、現代のAI活用の王道と言えるでしょう。

また、特定の業界で働くプロフェッショナルであれば、迷わず「業界特化型エンジン」を探してください。汎用AIが何年もかけて学習するような深い専門知識を、それらのツールは最初から備えています。バックオフィスや企画の現場でAIを使いこなすコツは、ツールに100%を依存するのではなく、そのツールの「得意不得意」を理解して、上手に使い分けることにあるかなと思います。

この記事のまとめ

- 精度は数値(WER/CER)だけでなく、編集のしやすさや話者分離を含めて評価する

- 用途に応じてAPI型、議事録特化型、業界特化型を使い分ける

- ビジネス利用では、データの学習利用の有無などセキュリティを最優先でチェックする

文字起こしは、単なる作業の自動化ではありません。AIに「書く」ことを任せることで、私たちは「考える」ことや「対話する」ことに、より多くの時間を使えるようになります。それが、私たちがAIツールを導入する本当の目的であり、最大の価値ではないでしょうか。この記事が、皆さんの業務をよりクリエイティブで楽しいものに変える一助となれば、これほど嬉しいことはありません。最新の機能やプランの詳細は、ぜひ各サービスの公式サイトでチェックしてみてください。皆さんの「最高の一台」が見つかることを、心から願っています!

※本記事の内容は2026年4月29日時点の調査に基づいています。AI技術の進化は非常に早いため、導入の際は必ず各ベンダーから最新の情報を取得し、デモや試用を通じて自社の要件を満たしているか確認してください。最終的な契約判断は自己責任において行っていただくようお願いいたします。